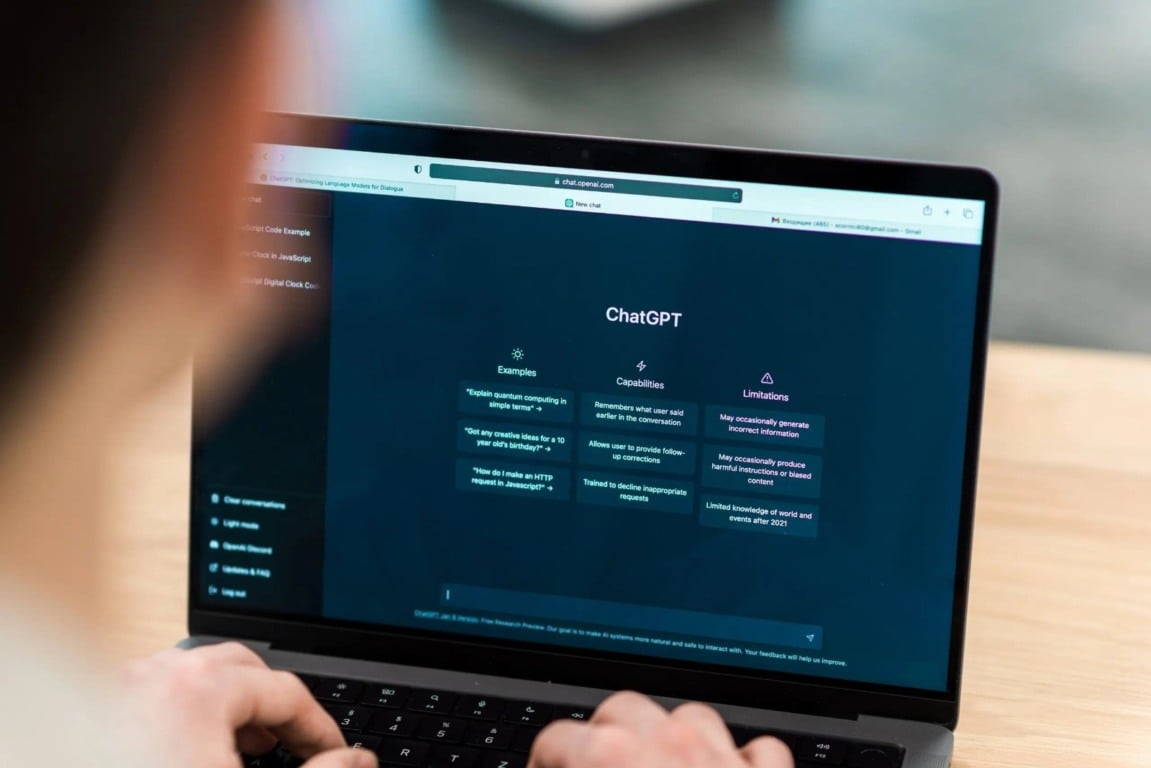

Um professor de História de uma universidade dos Estados Unidos desenvolveu uma técnica engenhosa para identificar alunos que utilizam Inteligência Artificial (IA), como o ChatGPT, para produzir trabalhos acadêmicos. A estratégia surgiu porque as ferramentas tradicionais antiplágio se mostraram ineficazes contra textos gerados por IAs.

Na ausência de tecnologia capaz de detectar a IA, o professor recorreu a uma solução manual:

- Inserção de Código Invisível: Ele adicionou blocos de texto nas instruções dos trabalhos que eram invisíveis a olho nu para os alunos, mas legíveis pela IA quando o enunciado completo era submetido.

- A Diretriz Armadilha: Essa mensagem invisível continha uma diretriz fora de contexto, solicitando, por exemplo, que o texto adotasse uma “leitura marxista” do livro em análise.

O teste foi aplicado em um trabalho de primeiro ano sobre a obra Gabriel’s Rebellion, que trata de uma revolta de pessoas escravizadas em 1800.

A armadilha funcionou:

- De 122 redações entregues, 33 mencionaram sistematicamente o enfoque marxista, ativando o gatilho da trapaça.

- Após um apelo à honestidade feito à turma, outros 14 estudantes admitiram ter usado alguma IA na produção.

O número total de trabalhos envolvidos na trapaça chegou a quase 39% da turma. Embora alguns alunos tenham contestado, alegando serem penalizados por terem um “estilo correto demais”, nenhum deles conseguiu explicar o que era o marxismo ou a relevância daquela abordagem.